试验数据治理与处理分析的实践与策略

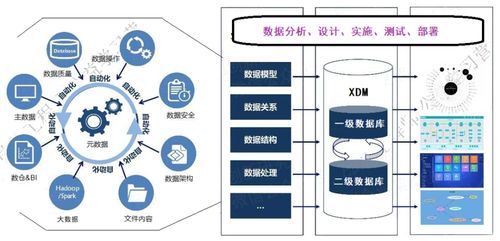

试验数据治理是科研与工程实践中的关键环节,它不仅关系到数据的质量与可靠性,还直接影响后续分析和决策的准确性。随着数据量的爆炸式增长,如何高效进行试验数据治理成为亟待解决的问题。本文将从数据收集、清理、存储到分析的全流程角度,探讨试验数据治理与处理的核心策略。

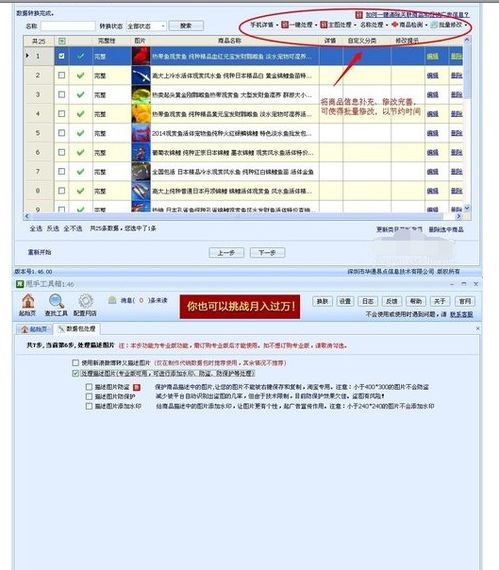

数据收集阶段需确保来源规范。试验数据通常来自传感器、仪器或人工记录,标准化采集协议和元数据管理至关重要。例如,为每个数据点添加时间戳、环境条件和实验人员信息,可防止数据混乱和误用。同时,采用自动化工具减少人为错误,是提升数据质量的第一步。

数据处理环节涉及数据清理、转换与集成。试验数据常包含噪声、缺失值或异常值,通过统计方法(如离群点检测)和算法(如插补技术)进行清理,能显著提高数据一致性。数据转换则包括归一化、标准化等操作,确保不同来源的数据具有可比性。在集成过程中,建立统一的数据模型和格式,便于后续分析。

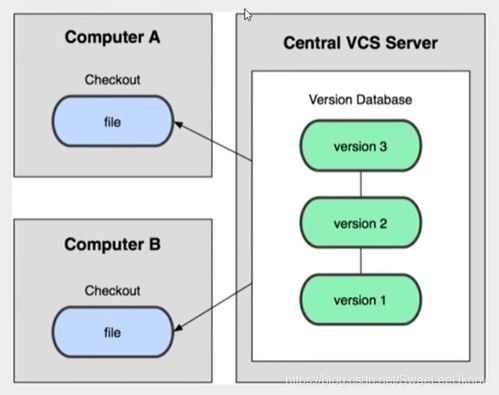

数据存储与安全是治理的核心。采用分层存储策略,将原始数据、处理后的数据和元数据分开管理,结合云存储或本地数据库,确保可访问性和可追溯性。安全方面,实施访问控制、加密和备份机制,防止数据泄露或丢失,符合法规要求如GDPR或行业标准。

数据分析需结合治理成果。通过可视化工具和机器学习算法,从处理后的数据中提取洞察,例如趋势分析、相关性识别或预测建模。有效的治理能够加速分析过程,降低错误率,最终支持科学发现或工程优化。

试验数据治理与处理分析是一个系统性工程,强调全流程协作。通过标准化、自动化和安全化措施,不仅能提升数据价值,还能推动创新与效率。企业和研究机构应投资于数据治理框架,以应对日益复杂的数据挑战。

如若转载,请注明出处:http://www.smxlzj.com/product/26.html

更新时间:2026-04-26 08:11:59